NVIDIA MCX555A-ECAT 100Gb/s シングルポート QSFP28 InfiniBand アダプター PCIe 3.0 x16 ConnectX-5 ネットワークカード

商品の詳細:

| ブランド名: | Mellanox |

| モデル番号: | MCX555A-ECAT |

| 書類: | CONNECTX-5 infiniband.pdf |

お支払配送条件:

| 最小注文数量: | 1個 |

|---|---|

| 価格: | Negotiate |

| パッケージの詳細: | 外箱 |

| 受渡し時間: | 備蓄に基づいた |

| 支払条件: | T/T |

| 供給の能力: | プロジェクト/バッチによる供給 |

|

詳細情報 |

|||

| 製品の状態: | ストック | 応用: | サーバ |

|---|---|---|---|

| 状態: | 新しい、オリジナル | タイプ: | 有線 |

| 最高速度: | EDRと100GBE | イーサネットコネクタ: | QSFP28 |

| ハイライト: | NVIDIA ConnectX-5 InfiniBand アダプター,100Gb/s QSFP28 ネットワークカード,PCIe 3.0 x16 Mellanox カード |

||

製品の説明

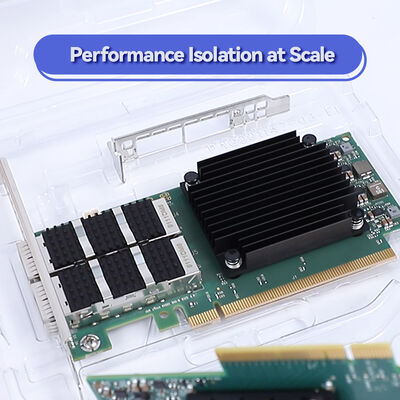

HPC、AI、クラウドデータセンター向けに設計された、高性能・低遅延の100Gb/sネットワークアダプター。NVMe over Fabrics、GPUDirect RDMA、MPIワークロード向けのタグマッチングなどの高度なオフロード機能を搭載し、業界をリードするスループットとCPU効率を実現します。

NVIDIA ConnectX-5 MCX555A-ECATは、ロープロファイルPCIeフォームファクターのシングルポート100Gb/s InfiniBandアダプターカードです。実績のあるConnectX-5アーキテクチャを活用し、サブマイクロ秒の遅延と高いメッセージレートで最大100Gb/sのスループットを提供します。InfiniBand(最大EDR)と100GbEの両方をサポートし、高性能コンピューティング、ストレージ、仮想化環境に柔軟な接続性を提供します。組み込みPCIeスイッチと高度なRDMA機能により、MCX555A-ECATはCPUから重要な通信タスクをオフロードし、アプリケーションパフォーマンスの向上、消費電力の削減、総所有コストの削減を実現します。PCIe 3.0 x16スロットと完全に互換性があり、幅広いオペレーティングシステムとアクセラレーションフレームワークをサポートしています。

主な機能

- ポートあたりの接続性(InfiniBand EDR / 100GbE)シングルQSFP28コネクタ

- 光学ケーブルまたは銅線ケーブル用PCIe 3.0 x16ホストインターフェイス

- (x8、x4、x2、x1に自動ネゴシエート)RDMA、送受信セマンティクス

- ハードウェアベースの信頼性の高いトランスポート付きタグマッチングとランデブーオフロード

- MPIおよびSHMEM用NVMe over Fabrics (NVMe-oF) ターゲットオフロード

- 効率的なストレージ用GPUDirect RDMA (PeerDirect)

- GPU通信のアクセラレーションハードウェアベースの輻輳制御とアダプティブルーティングサポート

- SR-IOV仮想化:

- 最大512の仮想機能RoHS準拠、ロープロファイルフォームファクター

- (トールブラケット付属)高度なテクノロジーとオフロード

MPIタグマッチングとランデブーオフロード:

- メッセージマッチングとランデブープロトコル処理をオフロードし、HPCクラスターのMPIパフォーマンスを劇的に向上させます。アダプティブルーティングによる順不同RDMA:

- 順序付けられた完了セマンティクスを維持しながら複数のネットワークパスの効果的な使用を可能にし、ファブリック利用率を最大化します。NVMe-oFターゲットオフロード:

- NVMeストレージシステムがCPUオーバーヘッドなしでリモートアクセスを提供できるようにし、ディスアグリゲートストレージアーキテクチャに最適です。動的接続トランスポート (DCT):

- 接続セットアップオーバーヘッドを排除することで、大規模なコンピューティングおよびストレージシステムの極端なスケーラビリティを提供します。ASAP2高速スイッチングおよびパケット処理:

- Open vSwitch (OVS) およびオーバーレイネットワークトンネリング(VXLAN、NVGRE、GENEVE)のハードウェアオフロード。オンデマンドページング (ODP):

- RDMA操作の仮想メモリページングをサポートし、アプリケーション開発を簡素化します。一般的なデプロイメント

- スーパーコンピューティングクラスター、MPIベースのシミュレーション、低遅延と高いメッセージレートを必要とする科学研究ワークロードに最適です。AIおよびディープラーニングトレーニング:

- GPUDirect RDMAと組み合わせることで、ノード間の高速なGPU間通信を可能にし、トレーニング時間を短縮します。NVMe-oFストレージシステム:

- NVMe over Fabrics環境でストレージターゲットまたはイニシエーターとして展開し、高スループット、低遅延のブロックストレージアクセスを実現します。クラウドおよび仮想化データセンター:

- SR-IOVと仮想化オフロードは、保証されたQoSとセキュアな分離を備えたマルチテナント環境をサポートします。高頻度取引 (HFT):

- 超低遅延とハードウェアタイムスタンプ(IEEE 1588v2)は、金融サービスアプリケーションの要求を満たします。互換性と相互運用性

オペレーティングシステムとソフトウェアスタック:

RHEL / CentOS、Ubuntu、Windows Server、FreeBSD、VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X、OpenMPI、MVAPICH2、Intel MPI、Platform MPI

- カーネルバイパス用のデータプレーン開発キット (DPDK)

- 技術仕様

| 仕様 | モデル |

|---|---|

| MCX555A-ECAT | 1x QSFP28、100Gb/s |

| 主な機能 | ポート速度とタイプ |

| 1x QSFP28、最大100Gb/s InfiniBand (EDR) および100GbE | ホストインターフェイス |

| フォームファクター | InfiniBandサポート |

| IBTA 1.3準拠、100Gb/s EDR、FDR、QDR、DDR、SDR; 8仮想レーン + VL15; 1600万I/Oチャネル | Ethernetサポート |

| 100GbE、50GbE、40GbE、25GbE、10GbE、1GbE; IEEE 802.3cd、802.3bj、802.3by、802.3ba、802.3ae | RDMA機能 |

| RDMA over Converged Ethernet (RoCE)、ハードウェア信頼性トランスポート、順不同RDMA、アトミック操作 | ストレージオフロード |

| NVMe over Fabricsターゲットオフロード、iSER、SRP、NFS RDMA、SMB Direct、T10 DIF署名ハンドオーバー | 仮想化 |

| SR-IOV(最大512仮想機能)、VMware NetQueue、NPAR、PCIeアクセス制御サービス(ACS) | CPUオフロード |

| TCP/UDP/IPステートレスオフロード、LSO/LRO、チェックサムオフロード、RSS/TSS、VLAN/MPLSタグ挿入/ストリッピング | オーバーレイネットワーク |

| VXLAN、NVGRE、GENEVEカプセル化/デカプセル化のハードウェアオフロード | 管理 |

| MCTP経由のNC-SI、モニター/コントロールおよびファームウェアアップデート用のPLDM、I2C、SPI、JTAG | リモートブート |

| InfiniBand、Ethernet、iSCSI経由のリモートブート; UEFI、PXEサポート | 消費電力 |

| 公表されていません。通常20W未満の範囲です。システムでご確認ください。 | 動作温度 |

| 0℃~55℃(通常環境) | 準拠 |

| RoHS、REACH、FCC、CE、VCCI、ICES、RCM | 注: 仕様はNVIDIA ConnectX-5製品ドキュメントに基づいています。最新の詳細およびファームウェアサポートについては、公式のNVIDIAリリースノートを参照してください。 |

選択ガイド – ConnectX-5ファミリー

| ポート/速度 | ホストインターフェイス | フォームファクター | 主な機能 | MCX555A-ECAT |

|---|---|---|---|---|

| 1x QSFP28、100Gb/s | PCIe 3.0 x16 | ホストインターフェイス帯域幅 | ConnectX-5 Ex、PCIe Gen4強化 | MCX556A-ECAT |

| 2x QSFP28、100Gb/s | 2x PCIe 3.0 x8 | ホストインターフェイス帯域幅 | ConnectX-5 Ex、PCIe Gen4強化 | MCX556A-EDAT |

| 2x QSFP28、100Gb/s | 2x PCIe 3.0 x8 | ロープロファイルPCIe | ConnectX-5 Ex、PCIe Gen4強化 | MCX556M-ECAT-S25 |

| 2x QSFP28、100Gb/s | 2x PCIe 3.0 x8 | ソケットダイレクト | ハーネス経由のデュアルソケットサーバー接続 | MCX545B-ECAN |

| 1x QSFP28、100Gb/s | PCIe 3.0 x16 | ホストインターフェイス帯域幅 | Open Compute Projectフォームファクター | OCPまたはマルチホストバリアントについては、営業にお問い合わせください。すべてのカードは下位速度への後方互換性をサポートしています。 |

ConnectX-5 MCX555A-ECATを選択する理由

- MPI、NVMe-oF、オーバーレイのハードウェアオフロードにより、CPUコアをビジネスロジックに解放します。スケーラブルなRDMAファブリック:

- DCT、XRC、順不同RDMAは、数千ノードの線形スケーラビリティを提供します。GPUアクセラレーション対応:

- GPUDirect RDMAは、GPUとネットワークアダプター間の直接メモリアクセスを可能にし、AIクラスターのCPUボトルネックを解消します。柔軟なデプロイメント:

- シングルQSFP28ポートはケーブリングを簡素化し、100Gb/sリーフスパインアーキテクチャに最適です。投資保護:

- InfiniBandとEthernetの両方をサポートしているため、ニーズの変化に応じてプロトコル間をシームレスに移行できます。サービスとサポート

サーバーおよびスイッチインフラストラクチャとの互換性検証

- HPCまたはストレージワークロードのパフォーマンスチューニング

- カスタムブラケットオプションおよびバルクパッケージ要件

- RMA処理および高度な交換サービス

- ボリューム価格とリードタイムについては、営業エンジニアにお問い合わせください。

よくある質問

アダプターを取り扱う際は、常にESD安全対策を使用してください。設置まで静電気防止パッケージに保管してください。冷却要件:サーバーシャーシ内の適切なエアフローを確保し、動作温度を指定範囲内に維持してください。ファームウェアアップデート:NVIDIA公式ファームウェアツール(MFT)を使用し、アップデート前にOSおよびドライバーバージョンとの互換性を確認してください。ケーブルの曲げ:信号劣化を避けるため、QSFP28ケーブルの曲げ半径ガイドラインに従ってください。これはクラスA製品です。住宅環境では電波干渉を引き起こす可能性があります。地域の規制に従って、適切なシールドと接地を行ってください。

Hong Kong Starsurge Group Co., Limitedについて

Hong Kong Starsurge Group Co., Limitedは、ネットワークハードウェア、ITサービス、システムインテグレーションソリューションのテクノロジー主導型プロバイダーです。ネットワークスイッチ、NIC、ワイヤレスアクセスポイント、コントローラー、高速ケーブリングなどの製品を世界中のお客様に提供するStarsurgeは、深い技術的専門知識と顧客第一のアプローチを組み合わせています。同社は、政府、ヘルスケア、製造、教育、金融、エンタープライズなどの業界をサポートし、IoTソリューション、ネットワーク管理システム、カスタムソフトウェア開発、多言語グローバルデリバリーを提供しています。信頼性の高い品質と迅速なサービスに重点を置き、Starsurgeはクライアントが効率的でスケーラブルで信頼性の高いネットワークインフラストラクチャを構築するのを支援します。主な事実 – NVIDIA MCX555A-ECAT

| 互換性ステータス | 注 | NVIDIA Quantum InfiniBandスイッチ |

|---|---|---|

| 認定済み | 100GbE、50GbE、25GbEモードをサポート | NVIDIA Spectrum Ethernetスイッチ |

| 認定済み | 100GbE、50GbE、25GbEモードをサポート | サードパーティ製100GbEスイッチ |

| 互換性あり | IEEE標準準拠が必要。主要ベンダーでテスト済み | GPUサーバー(NVIDIA DGX、HGX) |

| GPUDirectで認定済み | マルチGPU通信のRDMAアクセラレーション | NVMe-oF対応ストレージアレイ |

| サポート対象 | ターゲットオフロードにより効率的なNVMeファブリックアクセスが可能 | バイヤーチェックリスト – 100Gb/s InfiniBandアダプター |

- ☑ ポート数を確認してください:シングルポート(MCX555A-ECAT)対デュアルポート(MCX556A-ECAT)。

- ☑ ケーブルタイプを選択してください:短距離(≤5m)の場合はパッシブ銅線DAC、長距離の場合は光学ケーブル。

- ☑ オペレーティングシステムとドライバーのサポート(OFED、Windows、VMware)を確認してください。

- ☑ GPUクラスターの場合は、GPUDirect RDMAがGPUモデルとドライバーバージョンと互換性があることを確認してください。

- ☑ サーバーシャーシに必要なブラケットがトールかショートかを確認してください。

- 関連製品

- NVIDIA MCX556A-EDAT – PCIe 4.0サポート付きConnectX-5 Ex

- NVIDIA Quantum-2 QM9700 40ポート800Gb/s InfiniBandスイッチ

- Mellanox QSFP28パッシブDACケーブル(1m、2m、3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE Ethernetスイッチ

- 関連ガイドとリソース

- RDMA over Converged Ethernet (RoCE) デプロイメントガイド

- AIクラスター向けGPUDirect RDMAベストプラクティス

- ConnectX-5でのNVMe over Fabrics – 設定ガイド

- OFEDインストールおよびチューニングガイド