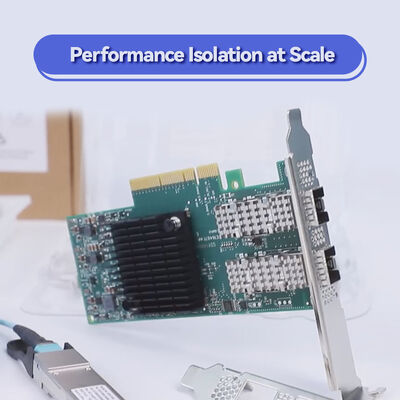

NVIDIA ConnectX-6 MCX653105A-HDAT 200Gb/s シングルポート InfiniBand スマートアダプター (ハードウェア暗号化 & PCIe 4.0 搭載)

商品の詳細:

| ブランド名: | Mellanox |

| モデル番号: | MCX653105A-HDAT |

| 書類: | connectx-6-infiniband.pdf |

お支払配送条件:

| 最小注文数量: | 1個 |

|---|---|

| 価格: | Negotiate |

| パッケージの詳細: | 外箱 |

| 受渡し時間: | 備蓄に基づいた |

| 支払条件: | T/T |

| 供給の能力: | プロジェクト/バッチによる供給 |

|

詳細情報 |

|||

| 製品の状態: | ストック | 応用: | サーバ |

|---|---|---|---|

| 状態: | 新しい、オリジナル | タイプ: | 有線 |

| 最高速度: | 最大200 gb/s | イーサネットコネクタ: | QSFP56 |

| モデル: | MCX653105A-HDAT | ||

| ハイライト: | NVIDIA ConnectX-6 インフィニバンドアダプタ,200Gb/s PCIe 4.0 ネットワークカード,ハードウェア暗号化搭載 InfiniBand アダプター |

||

製品の説明

200Gb/s シングルポート HDR スマート アダプタ ネットワーク内コンピューティングとハードウェア暗号化

NVIDIA ConnectX-6MCX653105A-HDAT単一のQSFP56ポートで完全な200Gb/sのスループットを提供し,超低レイテンシー,ハードウェアオフロード,ブロックレベルのXTS-AES暗号化を組み合わせます. HPC,AIクラスター,NVMe-oFストレージのために設計されています.このPCIe4.0 x16 アダプタは,集合操作,RDMA,および暗号化をCPUからオフロードし,要求の高いデータセンター環境でアプリケーションのパフォーマンスとスケーラビリティを最大化します.

についてMCX653105A-HDATNVIDIA ConnectX-6 InfiniBand アダプターファミリーに属し,近代的なデータセンターで極端な性能のために設計されています.200Gb/s(HDR InfiniBand または 200GbE) は,RDMA,信頼性の高い輸送,およびネットワーク内コンピューティングのための完全なハードウェア加速で,そしてNVMeはファブリックの加速に,アダプタは,CPUオーバーヘッドを大幅に削減し,ファブリック効率を向上させます.その内蔵されたAES-XTSブロックレベルの暗号化により,パフォーマンスの罰なしでデータセキュリティが保証されます.金融サービスに最適になる政府の研究や 超大規模クラウドの展開です

単一のQSFP56で最大200Gb/s (HDR InfiniBand / 200GbE)

最大2億5千万のメッセージ/秒

ブロックレベル XTS-AES 256/512ビット FIPS対応

集団卸荷,NVMe-oF ターゲット/イニシアター卸荷,バーストバッファー

PCIe Gen 4.0 / 3.0 x16 (後方対応)

SR-IOV (1K VFs),ASAP2,Open vSwitchオフロード,オーバーレイトンネル

RoCE,XRC,DCT,オン・デマンドページング,GPUDirect RDMAサポート

スタンドアップPCIe低プロフィール,高いブレーキをプリインストール + 短いブレーキを含む

NVIDIA ConnectX-6を統合するネットワーク内コンピューティングMCX653105A-HDATは,ハードウェアベースの信頼性の高いトランスポート,適応型ルーティング,混雑制御をサポートする.大型繊維の予測可能な性能を確保する.リモート・ダイレクト・メモリー・アクセス (RDMA)OS カーネルを回避して,ゼロコピーデータ転送を可能にします.NVIDIA GPUDirect RDMA についてネットワークアダプターと直接通信し,AIトレーニングとHPCシミュレーションの遅延を削減します.ブロックレベルのXTS-AES暗号化(256/512 ビットキー) は,CPUオーバーヘッドなしで転送中のデータと休止中のデータのセキュリティを保証し,アダプターはFIPS 140-2準拠要件を満たすために設計されています.

- 高性能コンピューティング (HPC):大規模シミュレーション,天気予報,計算流体動力学,低遅延 200Gb/sの相互接続を必要とする.

- AIとディープラーニング・クラスター:GPUDirect RDMAで分散トレーニングを行い,GPUノード間のスループットを最大化します.

- NVMe-oF ストレージシステム:高性能の分散型ストレージで,完全なターゲット/イニシアターオフロードで,CPU利用量を削減する.

- ハイパースケールとクラウドデータセンター:SR-IOV,オーバーレイネットワーク,ハードウェア加速暗号化による仮想環境

- 金融取引プラットフォーム:アルゴリズム取引のための超低レイテンシー決定的ネットワーク

ConnectX-6 MCX653105A-HDATは,NVIDIA量子インフィニバンドスイッチ (200Gb/s HDR),標準200GbEスイッチ,および幅広いサーバープラットフォームとシームレスに対応しています.主要なオペレーティングシステムと仮想化スタックをサポート既存のインフラに柔軟な統合を保証する.

| パラメータ | 仕様 |

|---|---|

| 製品モデル | MCX653105A-HDAT |

| データレート | 200Gb/s, 100Gb/s, 50Gb/s, 40Gb/s, 25Gb/s, 10Gb/s, 1Gb/s (インフィニバンドとイーサネット) |

| ポートとコネクタ | 1x QSFP56 (受動銅,アクティブ光学,AOCケーブルをサポート) |

| ホストインターフェース | PCIe Gen 4.0 x16 (Gen 3 にも対応する)02 について0; x8,x4,x2,x1の構成に対応) |

| 遅延時間 | 微秒未満 (典型的には<0.7μs) |

| メッセージ率 | 1秒間に最大2億5千万のメッセージ |

| 暗号化 | XTS-AES 256/512 ビット ハードウェア 解除 FIPS 140-2 準備 |

| 形状因数 | PCIe 低プロフィールスタンドアップ (高いブレーキをプリインストールし,短いブレーキのアクセサリーも含む) |

| 尺寸 (括弧なし) | 167.65mm×68.90mm |

| 電力消費量 | 典型的な22W 24W (リンク利用量によって異なります) |

| 仮想化 | SR-IOV (最大1Kの仮想機能),VMware NetQueue,NPAR,ASAP2フローオフロード |

| 管理と監視 | NC-SI,PCIe/SMBusによるMCTP,PLDM (DSP0248,DSP0267),I2C,SPIフラッシュ |

| リモートブート | InfiniBand, iSCSI,PXE,UEFI |

| オペレーティングシステム | RHEL,SLES,Ubuntu,Windows Server,FreeBSD,VMware vSphere,OpenFabricsエンタープライズディストリビューション (OFED),WinoF-2 |

| 注文部品番号 (OPN) | 港湾 | 最大速度 | ホストインターフェース | 主要 な 特徴 |

|---|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | シングルポート ハードウェア・暗号 完全なConnectX-6オフロード 高密度のサーバーに最適 |

| MCX653106A-HDAT | 2x QSFP56 | 200Gb/s (ダブルポート) | PCIe 3.0/4.0 x16 | 2つのポート 200Gb/s 暗号化,最大帯域幅密度 |

| MCX653105A-ECAT | 1x QSFP56 | 100Gb/s | PCIe 3.0/4.0 x16 | 低速度要求のためにコスト最適化されたシングルポート100Gb/s |

| MCX653106A-ECAT | 2x QSFP56 | 100Gb/s (ダブルポート) | PCIe 3.0/4.0 x16 | デュアルポート 100Gb/s,仮想化とストレージオフロード |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | OCP3.0 小型形式,ダブルポート 200Gb/s |

- 全200Gb/s帯域幅:シングルポート設計では,ポートごとに高密度が優先されるコンピューティングノードで最大限のスループットを提供します.

- ハードウェアセキュリティ 内蔵:規制された産業のためのFIPS準拠を満たすCPUオーバーヘッドなしでXTS-AESブロック暗号化

- アクセレレートストレージ&AI:NVMe-oFのオフロードとGPUDirect RDMAは,AIトレーニングとソフトウェア定義ストレージのパフォーマンスを大幅に向上させます.

- フューチャーレディPCIe40:200Gb/s ネットワークのボトルネックを取り除く.

- 管理の簡素化統一ドライバスタック (OFED,WINOF-2) と広範なOS互換性により,展開の複雑性が軽減される.

香港のスターサーージ・グループは,すべてのNVIDIA ConnectXアダプターに専門的な技術サポート,保証カバー,およびグローバルRMAサービスを提供しています.性能調整柔軟な価格設定 データセンタープロジェクトでの卸売価格設定 迅速な世界配送販売チームと連絡して,リードタイムとボリュームの割引について話し合います..

• PCIe スロットから十分な電力を供給しているかを確認します (スロットから75W,アダプタは典型的には~22-24W消費します).

液体冷却プラットフォームでは,この標準的な空気冷却カードは冷却プレートバリエーションと互換性がない.液体冷却SKUの需要については,Starsurgeに連絡してください.

• 200Gb/s の性能を達成するために,常に QSFP56 格付けのケーブルまたはモジュールを使用します.

• デプロイする前に OS とカーネルとのドライバ バージョンの互換性を確認します

2008年以来,香港スターズルージュグループ株式会社 (HK Starsurge Group Co., Limited) は,企業ネットワークハードウェア,システム統合,ITサービスの信頼できるプロバイダーとなっています.NVIDIAのネットワークソリューションの認可パートナーとしてStarsurgeは世界中の政府,金融,医療,教育,ハイパースケールクライアントに 本物の ConnectX アダプター,スイッチ,ケーブルを供給しています.経験豊富な販売と技術チームは,販売前のアーキテクチャから販売後のサポートまでシームレスな展開を保証します信頼性の高い品質と迅速なサービスへのコミットメントです

グローバル配信 · 多言語サポート · OEM&統合サービス

| 構成要素/生態系 | サポートステータス | コメント |

|---|---|---|

| NVIDIA 量子 HDR インフィニバンド スイッチ | ✓ 完全サポート | 200Gb/s 繊維,適応型ルーティング |

| 200GbEスイッチ (IEEE 802.3) | ✓ 互換性 | スイッチ仕様ごとに FEC モードが必要 |

| GPU ダイレクト RDMA | ✓ はい | NVIDIA GPUシリーズ (Volta,Ampere,Hopperなど) |

| VMware vSphere 7.0/8.0 | ✓ 認定 | ネイティブドライバー,SR-IOVサポート |

| Linux (RHEL,Ubuntu,SLES) | ✓ 全面的なサポート | MLNX_OFED,インボックスのドライバが利用可能 |

| Windows Server 2019/2022 について | ✓ サポート | WinOF-2 ドライバー パッケージ |

- [ ] 必要なリンク速度を確認します 200Gb/s シングルポートがノード帯域幅の要件を満たします

- [ ] サーバー PCIe スロット: x16 物理 スロット,Gen 4 完全な 200Gb/s 性能のために推奨.

- [ ] 適切なQSFP56ケーブルまたはトランシーバーを選択する (5mまで受動銅,AOC,または光学).

- [ ] OS ドライバーサポート (OFED バージョンまたは受信箱) を確認する.

- [ ] 暗号化遵守要件 (XTS-AES,FIPS) が満たされていることを確認する.

- [ ] 環境冷却を評価する:高速アダプタには,方向性のある空気流が必要である可能性がある.